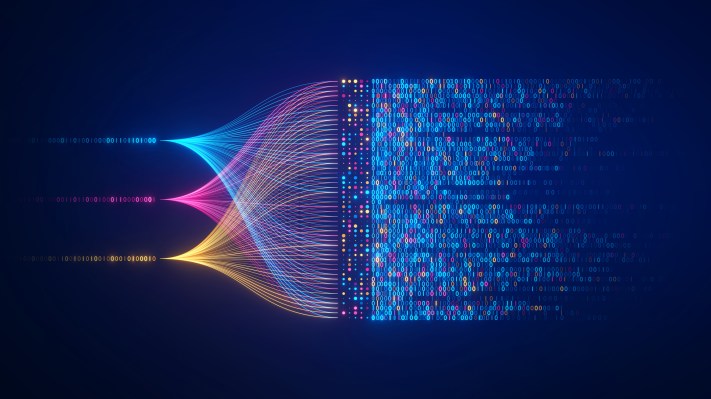

مدل جدید هوش مصنوعی AI21 Labs می تواند زمینه بیشتری را نسبت به سایر موارد کنترل کند

صنعت هوش مصنوعی به طور فزاینده ای به سمت مدل های هوش مصنوعی مولد با زمینه های طولانی تر حرکت می کند. اما مدلهایی با پنجرههای زمینه بزرگ معمولاً محاسباتی فشرده هستند. اوری گوشن، مدیر عامل استارتاپ هوش مصنوعی AI21 Labs، ادعا میکند که لازم نیست اینطور باشد – و شرکت او در حال انتشار یک مدل مولد برای اثبات آن است.

زمینهها یا پنجرههای زمینه به دادههای ورودی (مثلاً متن) اشاره میکنند که یک مدل قبل از تولید خروجی (متن بیشتر) در نظر میگیرد. مدلهایی با پنجرههای زمینه کوچک تمایل دارند محتوای مکالمات بسیار اخیر را فراموش کنند، در حالی که مدلهایی با زمینههای بزرگتر از این دام اجتناب میکنند – و به عنوان یک مزیت اضافی، جریان دادههایی را که دریافت میکنند بهتر درک میکنند.

Jamba آزمایشگاه AI21، یک مدل جدید تولید و تجزیه و تحلیل متن، میتواند بسیاری از کارهای مشابهی را انجام دهد که مدلهایی مانند ChatGPT OpenAI و Gemini گوگل انجام میدهند. Jamba که بر روی ترکیبی از داده های عمومی و اختصاصی آموزش دیده است، می تواند متن را به زبان های انگلیسی، فرانسوی، اسپانیایی و پرتغالی بنویسد.

Jamba می تواند تا 140000 توکن را در حالی که روی یک GPU با حداقل 80 گیگابایت حافظه اجرا می کند (مانند Nvidia A100 پیشرفته) مدیریت کند. این به حدود 105000 کلمه یا 210 صفحه ترجمه می شود – رمانی با اندازه مناسب.

در مقایسه، Llama 2 متا دارای یک پنجره زمینه 32000 توکنی است – در سمت کوچکتر با استانداردهای امروزی – اما برای اجرا فقط به یک GPU با 12 گیگابایت حافظه نیاز دارد. (پنجره های زمینه معمولاً با نشانه ها اندازه گیری می شوند که بیت هایی از متن خام و سایر داده ها هستند.)

جامبا از نظر ظاهری غیرقابل توجه است. تعداد زیادی از مدلهای هوش مصنوعی مولد و قابل دانلود رایگان در دسترس هستند، از DBRX اخیراً منتشر شده توسط Databricks تا Llama 2.

اما چیزی که جامبا را منحصر به فرد می کند، چیزی است که در زیر کاپوت وجود دارد. از ترکیبی از دو معماری مدل استفاده می کند: ترانسفورماتورها و مدل های فضای حالت (SSM).

ترانسفورماتورها معماری منتخب برای کارهای استدلالی پیچیده هستند، به عنوان مثال، مدل هایی مانند GPT-4 و Gemini گوگل را تقویت می کنند. آنها چندین ویژگی منحصر به فرد دارند، اما ویژگی مشخص ترانسفورماتورها “مکانیسم توجه” آنها است. برای هر قطعه از داده های ورودی (به عنوان مثال یک جمله)، ترانسفورماتور وزن کردن ارتباط هر ورودی دیگر (جملات دیگر) و از آنها برای تولید خروجی (یک جمله جدید) استفاده کنید.

از سوی دیگر، SSMها، چندین کیفیت از انواع قدیمیتر مدلهای هوش مصنوعی، مانند شبکههای عصبی تکراری و شبکههای عصبی کانولوشنال را ترکیب میکنند تا معماری محاسباتی کارآمدتری ایجاد کنند که قادر به مدیریت توالیهای طولانی از دادهها باشد.

اکنون SSM ها محدودیت های خود را دارند. اما برخی از تجسمهای اولیه، از جمله یک مدل منبع باز از محققان پرینستون و کارنگی ملون به نام Mamba، میتوانند ورودیهای بزرگتری را نسبت به معادلهای مبتنی بر ترانسفورماتور خود مدیریت کنند و در عین حال از آنها در وظایف تولید زبان بهتر عمل کنند.

جامبا در واقع از Mamba به عنوان مدل پایه استفاده می کند – و گوشن ادعا می کند که سه برابر توان عملیاتی را در زمینه های طولانی در مقایسه با مدل های مبتنی بر ترانسفورماتور با اندازه های مشابه ارائه می دهد.

گوشن در مصاحبه ای با TechCrunch گفت: «در حالی که چند نمونه اولیه آکادمیک از مدل های SSM وجود دارد، این اولین مدل تجاری در مقیاس تولید است. “این معماری، علاوه بر نوآوری و جالب بودن برای تحقیقات بیشتر توسط جامعه، امکان کارایی و توان عملیاتی بسیار خوبی را به وجود می آورد.”

در حال حاضر، در حالی که Jamba تحت مجوز Apache 2.0 منتشر شده است، یک مجوز منبع باز با محدودیتهای استفاده نسبتا کمی، Goshen تاکید میکند که این نسخه تحقیقاتی برای استفاده تجاری نیست. این مدل تضمینی برای جلوگیری از ایجاد متن سمی یا اقدامات کاهشی برای مقابله با سوگیری احتمالی ندارد. یک نسخه تنظیم شده و ظاهرا “ایمن تر” در هفته های آینده در دسترس خواهد بود.

اما گوشن ادعا میکند که جامبا حتی در این مرحله اولیه، نوید معماری SSM را نشان میدهد.

وی گفت: “ارزش افزوده این مدل، هم به دلیل اندازه و هم به دلیل معماری نوآورانه آن، این است که می توان آن را به راحتی بر روی یک واحد پردازش گرافیکی نصب کرد.” “ما معتقدیم که با دستیابی به ترفندهای اضافی Mamba عملکرد بیشتر بهبود خواهد یافت.”