جعل عمیق

-

دانش و فناوری

آیا فناوری انسان نسل را منقرض میکند؟

برنامههای هوش مصنوعی امروزی با هدف صداقت و راستی طراحی شدهاند. با این حال، یافتههای جدید موارد نگرانکنندهای را در این زمینه آشکار کرده است: هوش مصنوعی در حال یادگیری نحوه فریب انسانها است. طبق گزارش محققان در مجله پترنز(Patterns) هوش مصنوعی در بازیهای آنلاین و همچنین در دور زدن نرمافزارهای ضد بات، توانایی فریب انسانها را نشان داده است. این موضوع سوالات مهمی را در مورد ماهیت هوش مصنوعی و خطرات بالقوه آن مطرح میکند. پیتر پارک، پژوهشگر هوش…

-

دانش و فناوری

تیکتاک یک فناوری تشخیص جعل عمیق توسعه میدهد

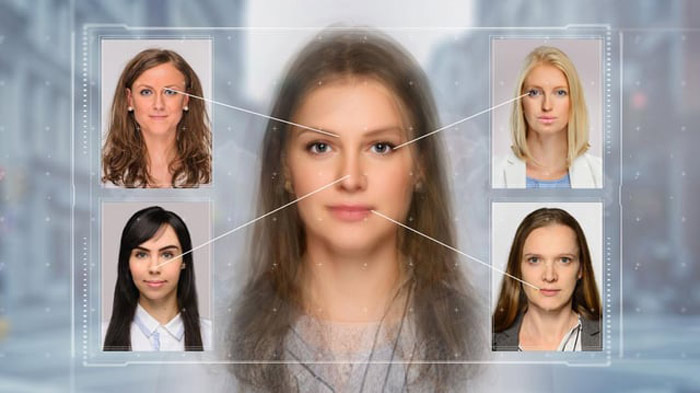

تیکتاک اولین پلتفرم رسانه اجتماعی خواهد بود که به طور خودکار برخی از محتوای تولید شده توسط هوش مصنوعی را برچسب گذاری میکند. به گزارش ایتنا، پیشرفتهای سریع در حوزه هوش مصنوعی مولد نگرانیها را در مورد انتشار اطلاعات نادرست و اطلاعات جعلی آنلاین افزایش میدهد. شرکتهایی مانند تیکتاک و متا، مالک فیسبوک، قبلاً از کاربران میخواهند تا تصاویر واقعی، کلیپهای تصویری و صوتی افشا کنند که آیا تصاویر واقعی، کلیپهای صوتی یا ویدیویی توسط برنامههای هوش مصنوعی تولید میشوند…

-

دانش و فناوری

شرکتهای فناوری جعل عمیق ساخته شده توسط هوش مصنوعی را شناسایی کنند

این توصیه بخشی از مجموعه دستورالعملهایی است که کمیسیون اروپا آن را در قالب قانون تعدیل محتوای فضای مجازی برای غولهای دیجیتال منتشر کرده تا آنها با خطراتی که انتخابات را تهدید میکند، از انتشار جمله اخبار نادرست، مقابله کنند. تعدیل محتوا عبارت از شناسایی محتویات همرسان شده در فضای مجازی و کامنتهای کاربران است به نحوی که شرکت پیامرسان بتواند محتوای مضر و آسیبرساننده را پیدا کرده و مثلا برای آن برچسب هشدار بگذارد. نهاد اجرایی اتحادیه اروپا مجموعهای…

-

دانش و فناوری

آیا درباره خطرات جعل عمیق اغراق میشود؟

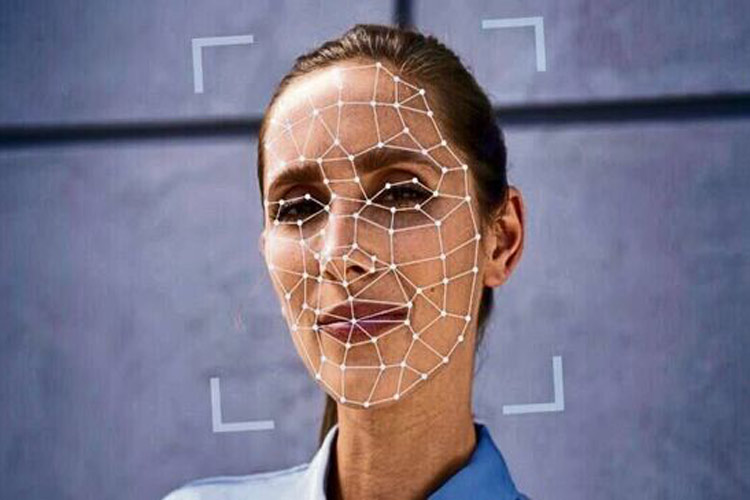

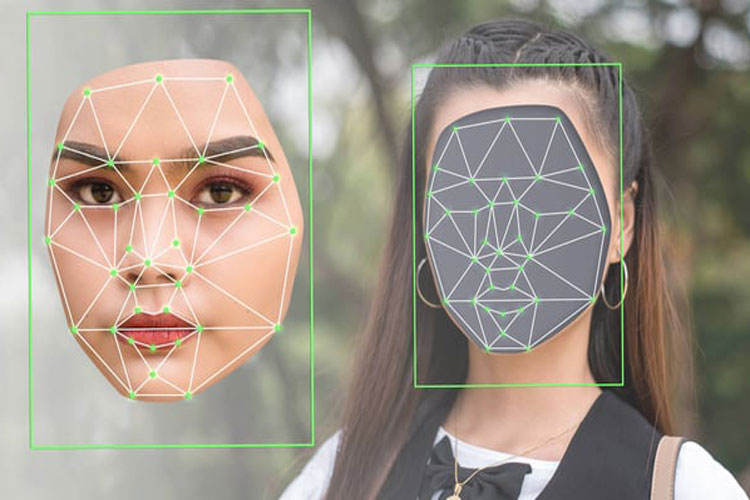

در عصر دیجیتالی که در آن زندگی میکنیم، مرز بین واقعیت و فانتزی مبهم شده است. ظهور فناوری جعل عمیق (دیپ فیک) نگرانیهای عمده و بحث های جنجالی را در مورد صحت محتوای بصری ایجاد کرده است. همانقدر که تصاویر دستکاری شده پیچیدهتر میشوند، درک فناوری زیربنایی و تاثیر بالقوه آن ضروریتر میشود، به خصوص که ظهور جعل عمیق پیامدهای زیادی برای جنبههای مختلف جامعه از جمله سیاست، روزنامه نگاری، سرگرمی و حریم خصوصی دارد. با کنترلهای صحیح و هوشیار…

-

دانش و فناوری

ماجرای هدیه ۱۰ هزار دلاری ایلان ماسک به کاربران رمزارزها چه بود؟

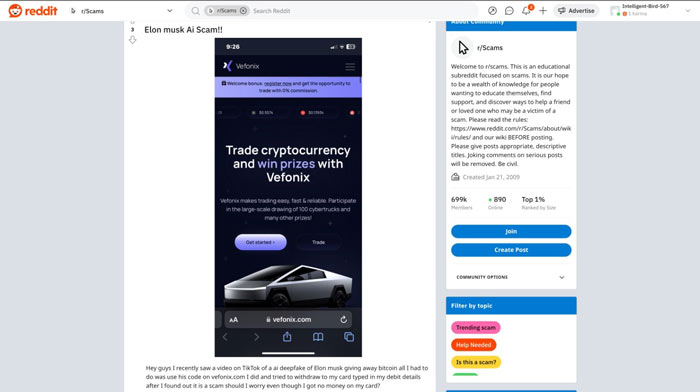

ویدئویی که اخیرا از برنامه «لست ویک تونایت»، منتشر شده، حاکی از آن است که ایلان ماسک تصمیم گرفت ۱۰ هزار دلار را به هر کسی که در یکی از سایتهای ارز دیجیتال حساب باز کند، هدیه بدهد. ناشران این ویدئو ادعا کردند آن بخشی از برنامه «لست ویک تونایت» است، که در آن، ایلان ماسک میلیاردر آمریکایی متعهد شده است ۱۰۰۰۰ دلار به هر کسی که در یکی از سایتهای ارز دیجیتال حساب باز کند، هدیه دهد. تعدادی از…

-

دانش و فناوری

کارشناسان هوش مصنوعی: دیپفیک قانونمند شود

کارشناسان هوش مصنوعی مدیران اجرایی صنعتی از جمله یوشوا بنجیو به عنوان یکی از پیشگامان این حوزه در نامه سرگشاده ای با توجه به ریسک های احتمالی دیپ فیک برای جامعه، خواهان تصویب قوانین بیشتری در این باره شدند. در این نامه که توسط اندرو کریچ محقق هوش مصنوعی نوشته شده، آمده است: امروزه دیپ فیک ها شامل تصاویر هرزنگاری، کلاهبرداری یا اخبار جعلی سیاسی هستند. از آنجا که هوش مصنوعی به سرعت در حال پیشرفت است و ساخت دیپ…

-

دانش و فناوری

تلاش متا و اوپنایآی برای جلوگیری از جا زدن تصاویر جعلی هوش مصنوعی به عنوان واقعی

این دو شرکت برچسبهای – پنهان یا به شکلی دیگر- را اضافه میکنند که باید به افراد امکان بدهد منبع تصویر یا سایر محتواها را ردیابی کند. اوپن ایآی ویژگیهای جدید را به چت جیپیتی و دال-ای۳ (DALL-E3) [نسخه پیشرفته اوپن ایآی از هوش مصنوعی] میافزاید که برچسبی را در فراداده تصویر قرار میدهد که مشخص میکند با هوش مصنوعی ایجاد شده است. در این ویژگی از استاندارد سی۲پیای (C2PA) استفاده خواهد شد و هدفش این است که بتوان اطلاعات…

-

دانش و فناوری

با ۵ بهترین ابزار و تکنیک برای تشخیص جعل عمیق آشنا شوید

در عصر دیجیتال، دیپ فیک به عنوان یک تهدید بزرگ برای اصالت محتوای آنلاین شناخته میشود. ویدیوهای تولید شده با هوش مصنوعی میتوانند به طور قانع کنندهای از افراد حقیقی تقلید کنند. تمایز واقعیت از دروغ را چنان دشوار میکند که میتواند همه چیز، از روابط شخصی گرفته تا انتخابات سیاسی را تحتالشعاع قرار دهد. خوشبختانه، همانطور که فناوری دیپ فیک (جعل عمیق) پیشرفت کرده است، ابزارها و تکنیکهای طراحی شده برای شناسایی آنها نیز پیشرفت کرده است. بنابراین، دراین…

-

دانش و فناوری

هشدار متا درباره برچسبگذاری محتوای تولید شده توسط هوش مصنوعی

متا در ماههای آینده با فرا رسیدن فصل انتخابات در سراسر جهان، برچسبگذاری (watermarking) عکسهای تولید شده توسط هوش مصنوعی که در فیسبوک، اینستاگرام و Threads آپلود شدهاند، را آغاز خواهد کرد. این شرکت همچنین به مجازات کاربرانی اقدام خواهد کرد که از برچسبگذاری برای ویدئوهای ساخته شده توسط هوش مصنوعی استفاده نمیکنند. نیک کلگ، رئیس امور جهانی متا، در مصاحبهای گفت که این گامها به منظور «گالوانیزه کردن» صنعت فناوری است، زیرا تشخیص دادن محتوای تولید شده توسط هوش…

-

دانش و فناوری

فیسبوک ویدیوهای جعلی را برچسبگذاری میکند

به گفته این نهاد، متا حق داشت که ویدیوی جعلی جو بایدن، رئیس جمهور ایالات متحده را حذف نکند، چون این ویدئو سیاست رسانهای این رسانه درباره دستکاری یک ویدیو را نقض نکرده بود. با این حال هیات نظارت این نهاد مستقل اعلام کرد که این سیاست نامنسجم است و باید پیش از اینکه انتخابات ریاست جمهوری آمریکا آغاز میشود، گسترش یابد. یکی از سخنگویان متا در این راستا گفت که در حال بازبینی این دستورالعمل است. متا گفت: «ما…

-

دانش و فناوری

فناوری جعل عمیق ۲۵ میلیون دلار خرج روی دست کارمند هنگکنگی گذاشت!

پلیس هنگ کنگ گفته است سارقان در این کلاهبرداری پیچیده، به عنوان «مدیر مالی» با کارمند تماس برقرار کرده و صحنه ویدئوکنفرانس را طوری چیده بودند که گویی چند نفر دیگر از کارکنان شرکت نیز در جلسه حضور دارند. در حالی که تمامی افراد در جلسه از طریق فناوری جعل عمیق درست شده بودند و واقعی نبودند. به گفته مقامات پلیس شخص کارمند در ابتدا به پیامی که ظاهراً از طرف مدیر ارشد مالی شرکت، مستقر در بریتانیا، فرستاده شده…

-

دانش و فناوری

کپی برابر اصل

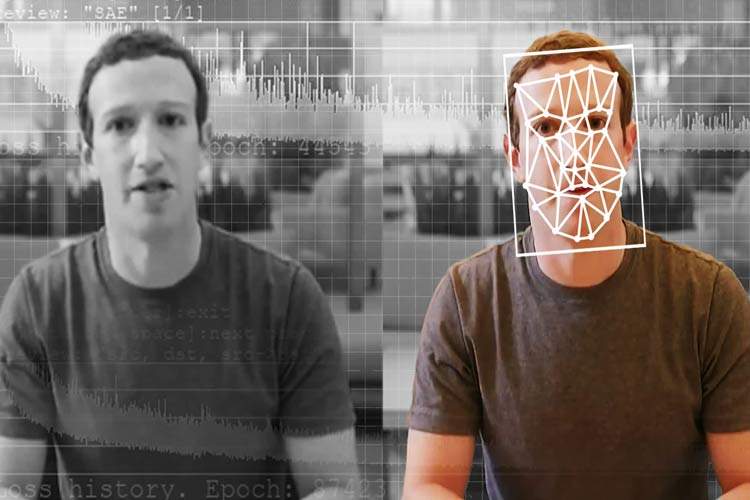

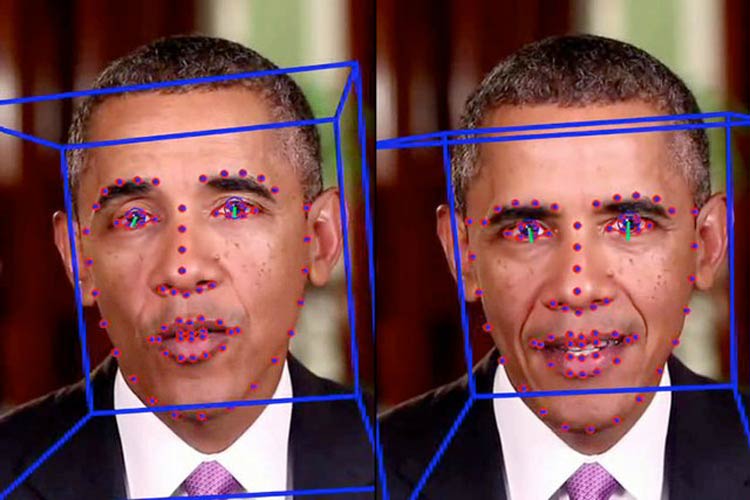

آیا تصاویر تام هنکس در حال تبلیغ برنامه دندانپزشکی، پاپ فرانسیس با یک کاپشن جذاب یا سناتور آمریکایی رند پل، روی پله عمارت کنگره با یک حوله حمام قرمز نشسته را دیدهاید؟ یا مصاحبهای را تماشا کردید که باراک اوباما که اصولاً به مبادیآداب بودن شهره بود، دونالد ترامپ را یک احمق خطاب کرده است؟ یا اخیراً تصاویر زنندهای از تیلور سوئیفت که بهطور گسترده در شبکههای اجتماعی منتشر شد؟ همه اینها «دیپفیک» یا تصاویر جعلی بودند که با واقعیت…

-

دانش و فناوری

چگونه از عکسهای خود در برابر جعل شدن توسط هکرهای هوش مصنوعی محافظت کنیم؟

ساخت عکسها و فیلم ها با استفاده از ویژگیهای هوش مصنوعی نسبت به قبل آسانتر شده، و به همین دلیل، تشخیص جعلی بودن عکسها دشوارتر شده است. بنابراین کاربران ناگزیرند به دنبال راه هایی برای جلوگیری از سوءاستفاده و محافظت از عکس ها و ویدیوهای خود باشند. مشاور ابزارهای هوش مصنوعی، خالد یوسری، با اشاره به نحوه حفظ عکسها و ویدیوهای شخصی در گردش آنها در شبکههای اجتماعی، خاطرنشان کرد: هنوز برنامه خاصی برای محافظت از تصاویر در برابر جعل توسط…

-

دانش و فناوری

سه پیشرفت ترسناک هوش مصنوعی در سال ۲۰۲۴

سال ۲۰۲۳ سالی مهم در تاریخ هوش مصنوعی بود. اما این تنها آغاز ماجرا بود. برخی از کارشناسان بر این باورند که در سال ۲۰۲۴ پیشرفتهای هراسانگیزی را از هوش مصنوعی شاهد خواهیم بود. از تولید محتوای جعلی و ساختگی تا بسیاری تواناییهای دیگر از جمله کاربردهای عملی چتجیپیتی. پدیده هوش مصنوعی، پدیده جدیدی نیست و از دههها پیش تاکنون وجود داشته است. اما آنچه که با گذشته متفاوت است این است که اکنون مردم عادی نیز با استفاده از…

-

دانش و فناوری

قوانین جدید هند برای دیپفیک

آشوینی وایشناو وزیر فناوری اطلاعات این کشور در جلسهای با کارشناسان، گروه های صنعتی و شبکه های اجتماعی گفت: ما تصمیم داریم پیش نویس قوانین را در چند هفته آینده تکمیل کنیم. به گزارش ایتنا از مهر، دیپ فیک ویدئوهای ساخته شده با سیستم های هوش مصنوعی هستند که با تصاویر آنلاین آموزش دیده اند و بسیار واقعی به نظر می رسند. مودی در اظهارات خود در جلسه مجازی کشورهای گروه ۲۰ از رهبران جهان خواست به طور مشترک برای…

-

دانش و فناوری

همه چیزهایی که باید درباره ویدیوهای جعلی بدانید

این روزها و با توجه به پیشرفت فنون تصویربرداری و تصویر سازی، تولید ویدئو کلیپهای جعلی نیز افزایش یافته است. در این گزارش مجموعه نکاتی که باید در مورد ویدیوهای جعلی بدانید، معرفی شده است: ویدیوهای جعلی چیست؟ ویدیوهای جعلی ویدئوهایی هستند که با استفاده از تکنیکهای هوش مصنوعی (AI) برای تبدیل تصویر یا صدای یک فرد به تصویر یا صدای شخص دیگری ایجاد میشوند و به نظر میرسد که او چیزهایی را گفته یا انجام داده است که هرگز…

-

دانش و فناوری

آموزش: تشخیص عکسهای جعلی در زمان جنگ با استفاده از گوشی موبایل

یک راه استفاده از سایت TinEye است. تصویر مورد نظر را دانلود یا آدرس آن را کپی کنید. سپس به TinEye بروید، گزینه “آپلود عکس” را انتخاب کنید و تصویر را آپلود نمایید. سپس میتوانید تصویر بارگذاری شده را با تصاویر قبلی مقایسه کنید تا مشخص شود آیا دستکاری شده است یا خیر. به گزارش ایتنا و به نقل از العین، راه دیگر استفاده از گوگل ایمیج است. تصویر را دانلود یا آدرس آن را کپی کنید. سپس به images.google.com…

-

دانش و فناوری

نکاتی در مورد ویدیوهای دیپفیک

این روزها و با توجه به پیشرفت فنون تصویربرداری و تصویر سازی، تولید ویدئو کلیپهای جعلی نیز افزایش یافته است. در این گزارش مجموعه نکاتی که باید در مورد ویدیوهای جعلی بدانید، معرفی شده است: ویدیوهای جعلی چیست؟ ویدیوهای جعلی ویدئوهایی هستند که با استفاده از تکنیکهای هوش مصنوعی (AI) برای تبدیل تصویر یا صدای یک فرد به تصویر یا صدای شخص دیگری ایجاد میشوند و به نظر میرسد که او چیزهایی را گفته یا انجام داده است که هرگز…

-

دانش و فناوری

بلایی که هوش مصنوعی بر سر زنان آورد

بر اساس گزارش «واشنگتن پست»، در حال حاضر، استفاده از ابزارها و برنامههای هوش مصنوعی برای تولید و پخش «تصاویر برهنگی» برای زنان بهویژه دختران نوجوان رو به افزایش است. در این گزارش آمده است: «با توجه به اینکه اکثر کشورهای جهان هنوز قوانین حاکم بر این ابزارها را تصویب نکردهاند، این مسئلهای زنان را در سراسر جهان تهدید میکند.» به گزارش ایتنا و به نقل از العین، روزنامه آمریکایی «گابی بل» اینفلوئنسر ۲۶ ساله را به عنوان نمونه آورد…

-

دانش و فناوری

چطور میتوان تصاویر واقعی را از تولیدات هوش مصنوعی تشخیص داد؟

تصاویری که پلتفرمهایی مثل Midjourney یا Dall-E تولید میکنند به قدری واقعی و پرجزئیات به نظر میرسند که تاکنون میلیونها نفر را در سراسر دنیا گمراه کردهاند. در برخی از موارد حتی به سختی میتوان تصویرهای جعلی ساخته شده با هوش مصنوعی را از تصاویر واقعی تشخیص داد. این روزها هر کسی میتواند با اتصال به اینترنت به ابزارهای تصویرسازی مبتنی بر هوش مصنوعی دسترسی پیدا کند و با آن تصاویر دلخواه خود را بسازد. با این حال این تصاویر…

- 1

- 2