دیپ فیک

-

دانش و فناوری

آموزش: چگونه عکسها و فیلمهای اصلاح شده با هوش مصنوعی را تشخیص دهیم؟

تصاویر تولید شده توسط هوش مصنوعی بهتر و بهتر میشوند، اما هنوز هم نشانههایی وجود دارد که میتوانید صحت و سقم آنها را بررسی کنید. لبههای اضافی، سبکهای ناهماهنگ و کاراکترهای تار میتوانند نشانهای از ایجاد یا ویرایش محتوا توسط هوش مصنوعی باشند. به گزارش ایتنا، در گذشته، فناوری دیپفیک کامل نبود و نشانههای واضحی از دستکاری بر جای میگذاشت. اما با بهبود هوش مصنوعی، فرآیند تشخیص جعلی بودن دشوارتر شده است و جستجوی الگوهای غیرعادی در ویدیوهای جعلی دیگر…

-

دانش و فناوری

افزایش نگرانیها از نقش هوش مصنوعی در «جعل عمیق» و انتشار اطلاعات نادرست

مایکروسافت میگوید اگرچه موارد چندانی از به کارگیری هوش مصنوعی برای ایجاد کارزارهای انتشار اطلاعات نادرست در انتخابات پارلمان اروپا را مشاهده نکرده، اما «انتخابات هنوز تمام نشده است» و نباید کار را تمام شده دانست. این در حالی است که موارد جعل عمیق، یا «دیپفیک»، تولید شده توسط هوش مصنوعی به طور فزایندهای در انتخابات در کشورهای مختلف جهان از جمله هند، ایالات متحده، پاکستان، و اندونزی مورد استفاده قرار گرفته است. برد اسمیت، رئیس شرکت مایکروسافت، روز دوشنبه…

-

دانش و فناوری

آیا فناوری انسان نسل را منقرض میکند؟

برنامههای هوش مصنوعی امروزی با هدف صداقت و راستی طراحی شدهاند. با این حال، یافتههای جدید موارد نگرانکنندهای را در این زمینه آشکار کرده است: هوش مصنوعی در حال یادگیری نحوه فریب انسانها است. طبق گزارش محققان در مجله پترنز(Patterns) هوش مصنوعی در بازیهای آنلاین و همچنین در دور زدن نرمافزارهای ضد بات، توانایی فریب انسانها را نشان داده است. این موضوع سوالات مهمی را در مورد ماهیت هوش مصنوعی و خطرات بالقوه آن مطرح میکند. پیتر پارک، پژوهشگر هوش…

-

دانش و فناوری

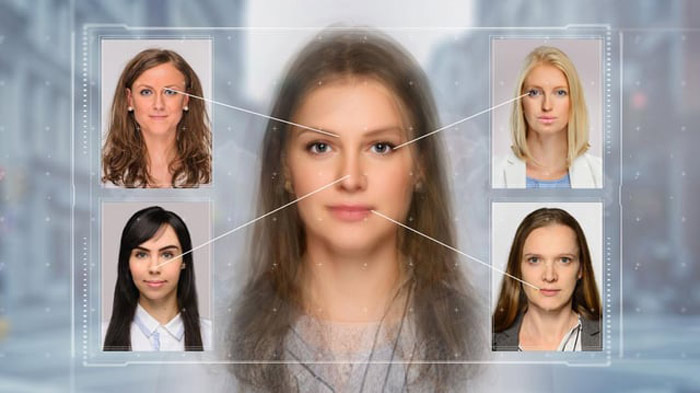

تیکتاک یک فناوری تشخیص جعل عمیق توسعه میدهد

تیکتاک اولین پلتفرم رسانه اجتماعی خواهد بود که به طور خودکار برخی از محتوای تولید شده توسط هوش مصنوعی را برچسب گذاری میکند. به گزارش ایتنا، پیشرفتهای سریع در حوزه هوش مصنوعی مولد نگرانیها را در مورد انتشار اطلاعات نادرست و اطلاعات جعلی آنلاین افزایش میدهد. شرکتهایی مانند تیکتاک و متا، مالک فیسبوک، قبلاً از کاربران میخواهند تا تصاویر واقعی، کلیپهای تصویری و صوتی افشا کنند که آیا تصاویر واقعی، کلیپهای صوتی یا ویدیویی توسط برنامههای هوش مصنوعی تولید میشوند…

-

دانش و فناوری

تلاش ناموفق هکرها برای کلاهبرداری از مدیرعامل بزرگترین شرکت تبلیغاتی جهان با هوش مصنوعی

رئیس بزرگترین گروه تبلیغاتی جهان، هدف یک حمله کلاهبرداری قرار گرفت که در آن از صدای شبیهسازیشده با هوش مصنوعی استفاده شده است. «مارک رید»، مدیرعامل شرکت تبلیغاتی بریتانیایی WPP در یک ایمیل جزئیات این حمله را شرح داد و به دیگر اعضای شرکت هشدار داد که مراقب تماسهایی باشند که ادعا میکنند از سوی مدیران ارشد هستند. تلاش ناموفق برای کلاهبرداری از مدیرعامل WPP با هوش مصنوعی براساس گزارش گاردین، کلاهبرداران ابتدا یک حساب واتساپ با تصویر پروفایل مدیرعامل…

-

دانش و فناوری

هوش مصنوعی کتی پری و ریانا را بدون دعوت به موزه متروپولیتن نیویورک برد

انتشار عکسهای جعلی کتی پری و ریانا، دو ستاره موسیقی پاپ در شبنشینی مد موزه متروپولیتن نیویورک خبرساز شده است. به گزارش ایتنا و به نقل از ایندیپندنت، کتی پری، با بازنشر عکسها در حساب اینستاگرام خود نوشت: «من کار میکردم و به برنامه نرفتم.» این ستاره موسیقی پاپ آمریکا میگوید حتی مادرش هم با دیدن تصاویر جعلی به اشتباه فکر کرده که دخترش در برنامه حضور داشته است. این عکسهای جعلی که اتفاقا با توجه به موضوع و درونمایه…

-

دانش و فناوری

OpenAI ابزاری برای شناسایی دیپفیکهای DALL-E عرضه میکند

با نزدیکشدن به انتخابات 2024 آمریکا، حساسیت قانونگذاران درباره انتشار دیپفیکهای تصویری و صوتی بیشازپیش شده است. اکنون OpenAI ابزاری را منتشر میکند که میتواند محتوای ایجادشده توسط هوش مصنوعی مولد DALL-E را شناسایی کند. براساس گزارش نیویورک تایمز، OpenAI ابزار تشخیص دیپفیک جدید خود را در اختیار گروه کوچکی از محققان حوزه اطلاعات جعلی قرار داده است تا بتوانند این ابزار را در موقعیتهای واقعی آزمایش کنند و آن را بهبود ببخشند. همچنین OpenAI گفته است که این ابزار…

-

دانش و فناوری

مدیرعامل ElevenLabs واترمارک دیجیتالی را راهحل مقابله با دیپفیکهای صوتی میداند

شرکت ElevenLabs که در زمینه تولید صدا با هوش مصنوعی فعالیت دارد، مدتهاست که با دیپفیک دستوپنجه نرم میکند. فناوری هوش مصنوعی مولد صدا، درحالی که کارکردهای مفید بسیاری دارد، اما پتانسیل آن برای سوءاستفاده نیز زیاد است. اکنون مدیرعامل ElevenLabs گفته است قراردادن واترمارک دیجیتالی روی صداهای هوش مصنوعی میتواند راهحل مقابله با دیپفیکهای صوتی باشد. براساس گزارش آتلانتیک، «متی استانیشفسکی» (Mati Staniszewski)، مدیرعامل و همبنیانگذار ElevenLabs، ضمن اشاره به اینکه مقابله با سوءاستفادهگران یک بازی موشوگربه خواهد بود،…

-

دانش و فناوری

یوتیوب از سازندگان ویدیوها میخواهد که محتوای تولید شده با هوش مصنوعی را فاش کنند

یوتیوب در حال معرفی ابزار جدیدی است که از کاربران میخواهد محتوایی را که بینندگان میتوانند بهعنوان یک شخص، مکان یا رویداد واقعی اشتباه بگیرند، که با رسانههای تغییریافته یا مصنوعی، از جمله هوش مصنوعی مولد، ایجاد شده است، افشا کنند. به گزارش ایتنا، هدف از افشای اطلاعات جدید جلوگیری از فریب دادن کاربران است، زیرا ابزارهای مولد جدید هوش مصنوعی تشخیص واقعی و جعلی را دشوارتر میکنند. کارشناسان هشدار دادهاند که هوش مصنوعی و دیپفیک خطر قابلتوجهی در طول انتخابات…

-

دانش و فناوری

Imagen 2؛ سازنده کلیپ ویدئویی گوگل منتشر شد

در ماه فوریه، مشخص شد که مولد تصویر ساخته شده در Gemini، چتربات مبتنی بر هوش مصنوعی گوگل، به طور تصادفی تنوع جنسیتی و نژادی را در پیامهای مربوط به افراد وارد میکند که در نتیجه تصاویری از نازیهای دارای تنوع نژادی، در میان سایر نادرستیهای توهینآمیز ایجاد میکند. گوگل وعده داد که این اختلال را اصلاح و دوباره منتشر کند. در نهایت، این شرکت یک ابزار تولید تصویر پیشرفته به نام Imagen 2 را در پلتفرم توسعهدهنده Vertex AI…

-

دانش و فناوری

4 ابزار جدید از گوگل برای تایید اطلاعات و تصاویر

در عصر هوش مصنوعی، گوگل بر روی 4 ابزار جدید کار میکند که میتواند به شما کمک کند اخبار و محتوای موجود در وب را تأیید کنید، از جمله برجسته کردن تصاویری که ممکن است جعلی به نظر برسند. گوگل اخیراً بهروزرسانیهای عظیمی را انجام داده است و به غیر از معروفترین بهینهسازی موتورهای جستجو، ویژگیهای جدید زیادی نیز به آن اضافه شده است. گوگل در جدیدترین آپدیت خود، 4 گزینه جدید را برای موتور جستجوی اینترنتی خود معرفی کرد…

-

دانش و فناوری

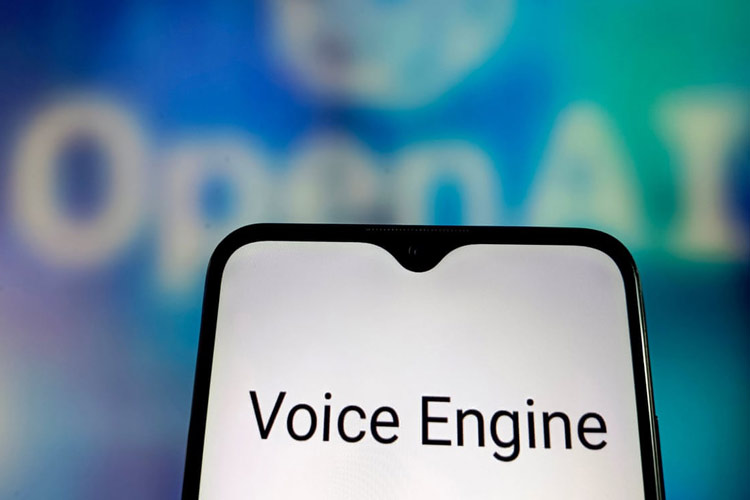

ابزار شبیه سازی صوتی OpenAI که کاربران هنوز نمیتوانند از آن استفاده کنند!

شبیهساز صدای اوپن ایآی یک توسعه API متن به گفتار است. این موتور صوتی به کاربران اجازه میدهد تا هر نمونه صدای 15 ثانیهای را برای تولید یک کپی مصنوعی از آن صدا آپلود کنند. هنوز تاریخ مشخصی برای عرضه عمومی این فناوری وجود ندارد. آموزش مدل و سنتز صدا مدل هوش مصنوعی مولدی است که Voice Engine بر روی ترکیبی از دادههای دارای مجوز و در دسترس عموم آموزش داده شده است. این شبیهساز صدا (Voice Engine) دارای زیربنای قابلیتهای…

-

دانش و فناوری

شرکتهای فناوری جعل عمیق ساخته شده توسط هوش مصنوعی را شناسایی کنند

این توصیه بخشی از مجموعه دستورالعملهایی است که کمیسیون اروپا آن را در قالب قانون تعدیل محتوای فضای مجازی برای غولهای دیجیتال منتشر کرده تا آنها با خطراتی که انتخابات را تهدید میکند، از انتشار جمله اخبار نادرست، مقابله کنند. تعدیل محتوا عبارت از شناسایی محتویات همرسان شده در فضای مجازی و کامنتهای کاربران است به نحوی که شرکت پیامرسان بتواند محتوای مضر و آسیبرساننده را پیدا کرده و مثلا برای آن برچسب هشدار بگذارد. نهاد اجرایی اتحادیه اروپا مجموعهای…

-

دانش و فناوری

آیا درباره خطرات جعل عمیق اغراق میشود؟

در عصر دیجیتالی که در آن زندگی میکنیم، مرز بین واقعیت و فانتزی مبهم شده است. ظهور فناوری جعل عمیق (دیپ فیک) نگرانیهای عمده و بحث های جنجالی را در مورد صحت محتوای بصری ایجاد کرده است. همانقدر که تصاویر دستکاری شده پیچیدهتر میشوند، درک فناوری زیربنایی و تاثیر بالقوه آن ضروریتر میشود، به خصوص که ظهور جعل عمیق پیامدهای زیادی برای جنبههای مختلف جامعه از جمله سیاست، روزنامه نگاری، سرگرمی و حریم خصوصی دارد. با کنترلهای صحیح و هوشیار…

-

دانش و فناوری

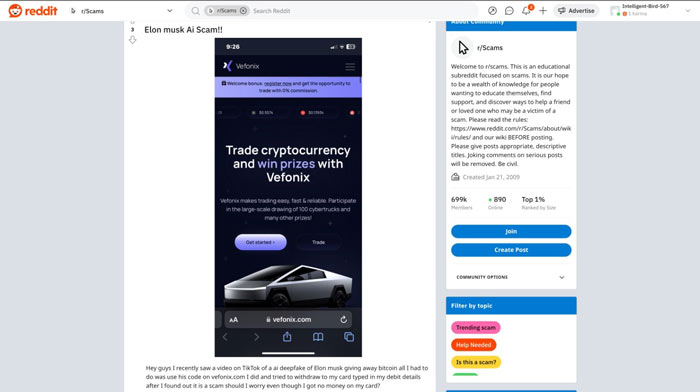

ماجرای هدیه ۱۰ هزار دلاری ایلان ماسک به کاربران رمزارزها چه بود؟

ویدئویی که اخیرا از برنامه «لست ویک تونایت»، منتشر شده، حاکی از آن است که ایلان ماسک تصمیم گرفت ۱۰ هزار دلار را به هر کسی که در یکی از سایتهای ارز دیجیتال حساب باز کند، هدیه بدهد. ناشران این ویدئو ادعا کردند آن بخشی از برنامه «لست ویک تونایت» است، که در آن، ایلان ماسک میلیاردر آمریکایی متعهد شده است ۱۰۰۰۰ دلار به هر کسی که در یکی از سایتهای ارز دیجیتال حساب باز کند، هدیه دهد. تعدادی از…

-

دانش و فناوری

کارشناسان هوش مصنوعی: دیپفیک قانونمند شود

کارشناسان هوش مصنوعی مدیران اجرایی صنعتی از جمله یوشوا بنجیو به عنوان یکی از پیشگامان این حوزه در نامه سرگشاده ای با توجه به ریسک های احتمالی دیپ فیک برای جامعه، خواهان تصویب قوانین بیشتری در این باره شدند. در این نامه که توسط اندرو کریچ محقق هوش مصنوعی نوشته شده، آمده است: امروزه دیپ فیک ها شامل تصاویر هرزنگاری، کلاهبرداری یا اخبار جعلی سیاسی هستند. از آنجا که هوش مصنوعی به سرعت در حال پیشرفت است و ساخت دیپ…

-

دانش و فناوری

تلاش متا و اوپنایآی برای جلوگیری از جا زدن تصاویر جعلی هوش مصنوعی به عنوان واقعی

این دو شرکت برچسبهای – پنهان یا به شکلی دیگر- را اضافه میکنند که باید به افراد امکان بدهد منبع تصویر یا سایر محتواها را ردیابی کند. اوپن ایآی ویژگیهای جدید را به چت جیپیتی و دال-ای۳ (DALL-E3) [نسخه پیشرفته اوپن ایآی از هوش مصنوعی] میافزاید که برچسبی را در فراداده تصویر قرار میدهد که مشخص میکند با هوش مصنوعی ایجاد شده است. در این ویژگی از استاندارد سی۲پیای (C2PA) استفاده خواهد شد و هدفش این است که بتوان اطلاعات…

-

دانش و فناوری

با ۵ بهترین ابزار و تکنیک برای تشخیص جعل عمیق آشنا شوید

در عصر دیجیتال، دیپ فیک به عنوان یک تهدید بزرگ برای اصالت محتوای آنلاین شناخته میشود. ویدیوهای تولید شده با هوش مصنوعی میتوانند به طور قانع کنندهای از افراد حقیقی تقلید کنند. تمایز واقعیت از دروغ را چنان دشوار میکند که میتواند همه چیز، از روابط شخصی گرفته تا انتخابات سیاسی را تحتالشعاع قرار دهد. خوشبختانه، همانطور که فناوری دیپ فیک (جعل عمیق) پیشرفت کرده است، ابزارها و تکنیکهای طراحی شده برای شناسایی آنها نیز پیشرفت کرده است. بنابراین، دراین…

-

دانش و فناوری

هشدار متا درباره برچسبگذاری محتوای تولید شده توسط هوش مصنوعی

متا در ماههای آینده با فرا رسیدن فصل انتخابات در سراسر جهان، برچسبگذاری (watermarking) عکسهای تولید شده توسط هوش مصنوعی که در فیسبوک، اینستاگرام و Threads آپلود شدهاند، را آغاز خواهد کرد. این شرکت همچنین به مجازات کاربرانی اقدام خواهد کرد که از برچسبگذاری برای ویدئوهای ساخته شده توسط هوش مصنوعی استفاده نمیکنند. نیک کلگ، رئیس امور جهانی متا، در مصاحبهای گفت که این گامها به منظور «گالوانیزه کردن» صنعت فناوری است، زیرا تشخیص دادن محتوای تولید شده توسط هوش…

-

دانش و فناوری

فیسبوک ویدیوهای جعلی را برچسبگذاری میکند

به گفته این نهاد، متا حق داشت که ویدیوی جعلی جو بایدن، رئیس جمهور ایالات متحده را حذف نکند، چون این ویدئو سیاست رسانهای این رسانه درباره دستکاری یک ویدیو را نقض نکرده بود. با این حال هیات نظارت این نهاد مستقل اعلام کرد که این سیاست نامنسجم است و باید پیش از اینکه انتخابات ریاست جمهوری آمریکا آغاز میشود، گسترش یابد. یکی از سخنگویان متا در این راستا گفت که در حال بازبینی این دستورالعمل است. متا گفت: «ما…